구글이 눈에서 얼굴 표정을 추측하는 새로운 인공지능(AI) 기술을 공개해 관심을 모은다.

가상현실(VR)용 고글을 착용하면 얼굴의 상당 부분이 숨겨져 버리기 때문에 커뮤니케이션에 있어 중요한 역할을 하는 표정이 잘 보이지 않는다.

이에 구글은 지난 2월에도 VR 고글 착용자의 표정을 합성하는 복합현실(MR) 기술을 선보이기도 했다. 이는 ‘고글의 시스루 효과’라고도 불리는데, 고글 착용자의 얼굴을 촬영하고, 3D 표정 및 시선 모델을 만들어 영상을 합성시키는 방식이다.

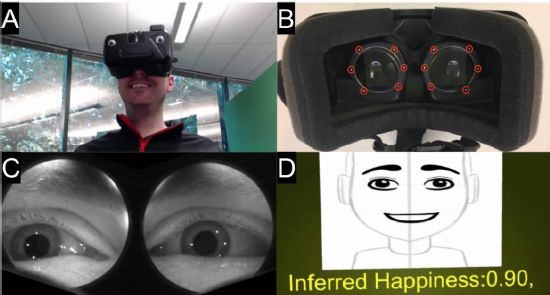

이번에 구글이 새롭게 공개한 새 AI 기술인 ‘아이모션’(Eyemotion)은 눈을 통해 그 사람의 표정을 추측하는 서비스다.

이 기술은 VR 고글 내부에 장착된 적외선 시선 추적 카메라의 데이터를 이용해 AI가 얼굴 표정을 짐작한다. 딥러닝의 일종인 심층 회선 신경망(Convolutional Neural Network : CNN)기술을 적용했다.

카메라에서 얻은 정보는 시선의 방향과 윙크, 동공과 눈꺼풀, 눈썹, 미간의 움직임 정도에 한정되지만 높은 수준의 추측이 가능한 것으로 알려졌다.

표정 추측은 실시간으로 실행되기 때문에 VR 고글 착용자의 표정을 바로 아바타에 적용시킬 수 있다.

관련기사

- 'AI 왕따설'에 발끈한 페이스북…"낚시 기사다"2017.08.03

- 네이버 음란물 필터링 AI 직접 실험해보니2017.08.03

- 너무 똑똑해진 AI…자신만의 은어로 대화 '충격'2017.08.03

- 페북, 텍스트 전문 AI 스타트업 오즐로 인수2017.08.03

이와 비슷한 서비스로는 크라우드 펀딩 서비스 킥스타터를 통해 자금을 모으고 있는 ‘비소’(Veeso)라는 제품도 있다. 이 제품은 2개의 적외선 카메라로 눈과 눈 주위, 입, 턱의 움직임을 파악하고 그 정보에 따라 아바타의 표정을 바꾸는 VR 고글이다.

구글은 아이모션 기술 시연을 캘리포니아주 로스앤젤레스에서 개최 중인 기술업계 행사인 ‘시그래프 2017 이머징 테크놀로지’에서 선보이기로 했다.(▶관련동영상 보기)