검색을 넘어 기기, 스마트카 등 생활 전반의 영역으로 사업을 확장하고 있는 구글이 ‘머신러닝’ 기술에 주력하고 있다.

머신러닝 기술을 다양한 서비스에 접목함으로써 사람들의 반복적이고 지겨운 잡무를 덜어주고, 사람의 지식을 뛰어넘는 정보와 편리함을 제공한다는 것이 구글의 목표다.

머신러닝이란 컴퓨터가 새로운 데이터가 들어왔을 때 알고리즘을 기반으로 학습하고, 축적된 데이터를 바탕으로 특정 질문이나 상황의 결과를 정확히 예측하는 기술을 말한다. 데이터가 쌓이고 학습의 빈도와 양이 많아질수록 사람에 가까운 판단과, 더 똑똑한 결과값이 만들어진다.

가령 공부 양에 따른 성적을 컴퓨터가 분석한다고 하면 과거에는 ‘공부 시간이 많을수록 성적이 오른다’와 같은 기본적인 결과 값만 계산이 됐다. 하지만 여기에 머신러닝 기술이 접목되면 공부의 질, 시험의 난이도, 기타 환경 등의 다양한 변수값이 반영되고 오류가 줄면서 실제에 가까운 결과가 도출된다.

현재 구글은 머신러닝 기술을 다양한 검색 서비스를 비롯해 ‘구글 포토’, ‘지메일’, ‘구글 번역’ 등에 활용하고 있다. 미래에는 자율주행차와 헬스케어 등으로 활용 범위를 넓힐 계획이다.

■컴퓨터가 내 말을 알아듣는다

이 중 구글의 강점인 검색 부문에 머신러닝 활용 사례를 살펴보면, 먼저 구글 음성 검색의 정확도 향상이 대표적이다. 국가별 언어에 따른 편차는 있지만 구글 음성 검색의 정확도는 머신러닝 기술을 통해 향상돼 왔다.

또 구글의 머신러닝은 사용자의 음성만을 인식하고 바로 결과를 표시하는 것이 아니라 그 의미와 문맥까지 분석하는 단계에 이르렀다. 이에 분석 결과의 질 또한 점차 높아지고 있다. 특정 장소를 검색하면 이 사람이 해당 장소에서 무엇을 하려는지, 또 무엇을 필요로 할지까지 예측해 제시해준다.

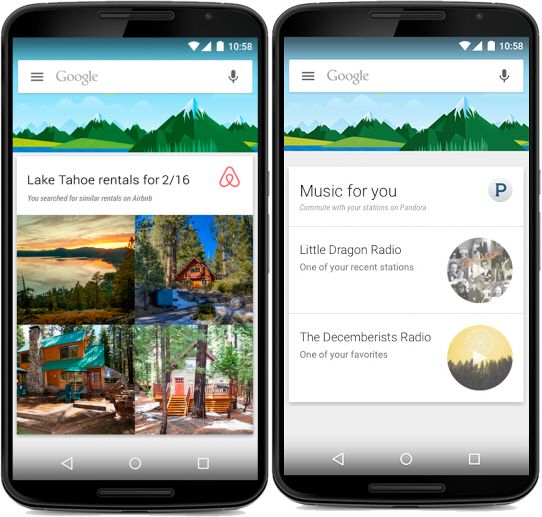

구글 안드로이드 최신 버전에는 ‘구글 나우’라고 해서 사용자가 현재 읽거나 보고 듣는 내용과 관련된 정보와 앱을 자동으로 알려주는 기능도 있다. 예를 들어 친구가 “이번 주말에 영화 마션보고 저녁 먹을까?”라는 문제메시지를 보내 왔다면 구글 나우는 영화와 식당에 대한 정보를 보여주고 리뷰 읽기, 메뉴보기, 식사 예약하기 등의 작업을 할 수 있는 앱으로 연결해 준다.

또 뉴스 웹사이트에서 엘론 머스크의 화성 진출 계획에 대한 이야기를 읽던 중이라면 구글 나우가 관련된 정보와 소셜미디어 링크, 뉴스 기사를 보여준다. 음악을 듣는 중이라면 가수에 대한 정보도 받아볼 수 있다.

■컴퓨터가 사진을 알아서 분류해준다

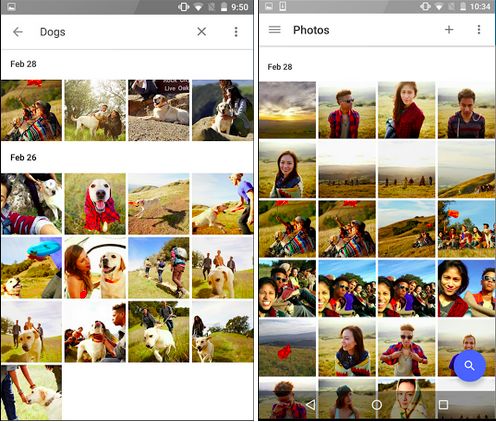

최근 구글이 자신 있게 내세우는 머신러닝 활용 기술은 바로 구글 포토다. 구글 포토는 사용자들이 휴대폰으로 찍는 사진들을 클라우드에 저장해주는 것뿐만 아니라 연관된 사진들을 한 그룹으로 묶어주고, 때에 따라서는 슬라이드 사진으로 만들어주며, 검색 기능까지 제공한다.

예를 들어 ‘한라산’을 탭하면 최근 한라산에서 찍은 사진을 모아볼 수 있다. 또 검색창에 ‘강아지’, ‘자동차’와 같은 특정 검색어를 입력라면 별도로 캡션이나 태그를 추가하지 않았어도 해당 검색어에 적합한 모든 사진을 볼 수 있다.

구글은 고도화된 구글 포토 기술을 바탕으로 유튜브 비디오 콘텐츠 검색 팀하고도 긴밀히 협력하고 있다. 사진에서 주요 특징을 잡아내고 여러 정보들을 축출해 내듯 움직이는 영상에서도 구글 포토와 같은 기능들을 구현하기 위해 연구 중인 것으로 알려졌다.

■컴퓨터가 전세계 언어를 하나로 만들어준다

구글의 머신러닝 기술의 또 다른 대표적인 활용 사례는 바로 구글 번역이다. 구글 번역은 무료 번역 도구로서, 매월 전세계 5억 명 이상의 사람들이 구글 번역을 이용하며 초당 1백만 개의 단어를 처리한다. 구글 번역은 크롬뿐 아니라 검색, 지메일 및 유튜브와 같은 구글 제품에서 바로 이용할 수 있도록 구현됐다. 구글 번역은 머신러닝 덕분에 오류가 23%에서 8%로 줄어드는 효과를 얻었다.

구글 번역의 작동 원리는 웹에 존재하는 수억개의 문서들을 기반으로 한다. 구글 번역에 단어나 문장이 입력되면 수많은 웹 문서에서 특정한 패턴을 찾아 비교하고, 어떤 번역이 가장 의미가 통하는지를 정교하게 추측해 내는 과정을 거친다. 방대한 양의 텍스트 속에서 일정한 패턴을 식별하는 ‘통계적 기계 번역’이 이뤄지는 것.

예를 들어 “오케이 구글”이라고 말해 음성 검색 기능을 켠 뒤 “강아지를 영어로 번역”이라고 말하면 바로 구글 번역 결과를 확인할 수 있다.

구글 번역앱은 보다 뛰어난 기능을 제공한다. 90개의 언어로 글을 쓰거나 입력할 수 있고, 69개의 언어로 손글씨를 쓸 수도 있다. 특히 번역 앱 즉석 카메라 번역 기능을 사용하면 카메라를 대는 순간 바로 텍스트가 번역되는데, 현재는 27개 언어로 지원된다. 해외여행 시 음식 메뉴와 표지판 등 빠른 번역이 필요할 때 유용하다.

아울러 구글 번역앱은 42개 언어로 음성 번역을 지원한다. 대화 모드를 사용해 32개 언어로 대화를 나눌 수도 있다. 사용자가 말하는 언어로 번역을 원하는 언어를 선택하고 마이크 버튼을 눌러 말하면 말과 동시에 실시간으로 번역이 이뤄진다. 외국인과의 대화에서 활용하면 된다.

■구글 머신러닝의 미래…자율주행, 헬스케어까지

구글은 머신러닝 앞으로 모든 서비스에 접목하는 것을 목표로 하고 있다. 현재 개발이 상당히 진척된 자율주행차에도 이 같은 머신러닝 기술을 접목해 안정성을 높이고 있다. 궁극적인 목표는 머신러닝을 통해 사람이 운전하는 것보다 훨씬 똑똑한 운전을 가능하게끔 만드는 것이다.

구글은 머신러닝 기술이 시각적으로 봤을 때 ‘사람이 보지 못하는 곳까지 본다’라는 개념보다는, ‘사람이 지나쳐 버리는 곳까지 놓치지 않고 본다’는 관점에서 다양한 분야에 활용될 것으로 보고 있다. 사람은 환경 변화나 컨디션에 따라 업무 능력이 달라질 수 있는데, 컴퓨터는 늘 일정하고 정확하게 일처리를 하기 때문에 효율적으로 활용될 수 있다는 시각이다.

이에 구글이 계획 중인 가까운 미래의 머신러닝 활용 서비스는 자율주행차와 헬스케어다. 최근 구글은 미국심장협회와 손잡고 심혈관계 질병 연구를 공동으로 진행하기로 했는데, 이 같은 연구와 치료에도 구글의 머신러닝 기술이 도입될 것으로 예측된다. 구글은 그 동안 ‘구글X’라는 비밀 프로젝트를 통해 당뇨병 관련 연구에도 많은 투자를 진행해 왔는데, 작년 초 공개한 당뇨병 환자용 ‘스마트 콘택트렌즈’ 기술을 개발하기도 했다.

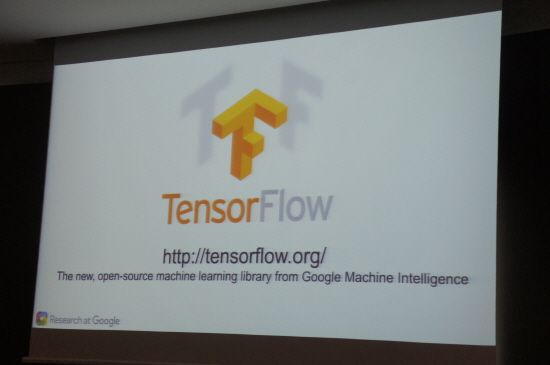

구글이 계획하는 머신러닝의 지향점은 수많은 데이터와 학습을 통해 단순한 결과값을 제시하는 것이 아니라 사용자의 의도와 의미까지 이해하는 시스템을 만드는 것이다. 나아가 구글은 자체 머신러닝 기술인 ‘텐서플로’를 오픈소스로 공개해 머신러닝의 생태계를 만들고, 이 안에서 최고의 서비스를 선보인다는 구상이다.

구글 지주회사인 알파벳의 에릭 슈미트 회장은 지난 10일 일본에서 열린 아태지역 기자 간담회에서 “컴퓨터가 인간을 대신해 많은 업무를 할 텐데, 사람들이 원하는 것을 알고 이를 알아서 해결해주는 역할을 할 것”이라며 “문자도 자동으로 인지하고 이메일도 자동으로 보고 처리해주는 등 인간 친화적인 머신러닝 기술이 발전할 것”이라고 전망했다.

관련기사

- 머신러닝, 빅데이터와 뭐가 다르지?2015.11.11

- 구글, 머신러닝 보물 왜 공짜로 풀었나2015.11.11

- 슈미트 “경쟁사도 구글 머신러닝 쓸 것”2015.11.11

- 구글이 말하는 미래 기술 ‘머신러닝’이란?2015.11.11

또 그는 “의학정보를 통해 결과값 예측이 가능해지고 정확해지면서 머신러닝은 의학, 의료 기구, 의사 지원에 중요해졌다”면서 “비영리, 공공 기관들이 구글의 머신러닝 기술을 자동으로 채택하지 않을까 싶다. 헬스케어 부문이 머신러닝을 통해 획기적으로 바뀔 것”이라고 내다봤다.

이어 “텐서플로를 더 똑똑한 분들이 사용할수록 우리도 혜택을 얻을 것으로 생각한다”며 “대부분 인공지능 그룹들(경쟁사)이 우리가 공개한 텐서플로를 활용할 거라는 자부심을 갖고 있다”고 밝혔다.