페이스북의 인공지능(AI) 실험 때문에 전 세계가 호들갑을 떨고 있다. 영국 더선이 “AI가 인간을 왕따시키고 자기들만의 언어로 대화하고 있다”고 보도한 게 시발점이 됐다.

이후 AI가 자기들끼리만 소통하는 언어를 만들어냈다는 쪽으로 보도가 확대되고 있다.

보도를 접하면서 살짝 두려워졌다. 사실일 경우 공상과학(SF) 영화에서나 보던 일이 실제로 일어난 셈이기 때문이다.

스탠리 큐브릭 감독의 명작 ‘스페이스 오디세이’ 이래 수 많은 SF 영화들은 기계가 지배하는 미래 세계를 그려냈다. 특히 ‘터미네이터’는 인간의 제어 범위를 뛰어넘은 기계의 반란을 실감나게 묘사하면서 많은 사랑을 받았다.

그래서 ‘팩트 체크’를 좀 해보고 싶어졌다. 정말로 AI가 인간을 왕따시키는 수준까지 발전한 건지도 알고 싶었다.

이번 보도는 영국 타블로이드 신문인 더선이 최초 보도하면서 널리 알려졌다. AI의 반란에 깜짝 놀란 페이스북이 아예 시스템을 작동하지 않도록 했다는 그럴듯한 설명까지 붙어 있었다.

궁금할테니 결론부터 먼저 제시하는 게 좋겠다. 미국 디지털문화 전문잡지 와이어드에 따르면 이번 해프닝은 오히려 현재 AI 기술의 한계를 보여주는 사례에 불과하다.

AI에 협상 능력을 부여하려던 실험을 하는 과정에서 오류가 생긴 것이란 얘기다. 잠시 와이어드의 설명을 따라가보자.

■ 문제가 된 AI, 한 가지 능력만 집중 훈련

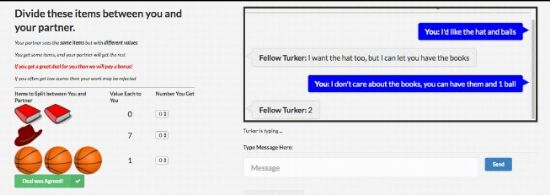

페이스북 팀은 AI의 협상 능력을 향상시키기 위해 2단계 교육을 실시했다.

첫째. 수 천 건의 협상 사례 때 사용된 대화 학습.

둘째. 협상 기술을 배양하는 과정에서 시행착오를 하도록 훈련.

AI 훈련엔 강화학습이 사용됐다. 알파고의 바둑 실력을 배양할 때 동원됐던 바로 그 학습법이다.

그런데 이 과정에서 오류가 발생했다. 훈련을 받던 AI가 해독 불능 문장을 사용하기 시작한 것. 그래서 페이스북 연구팀들은 AI의 작동을 중지시켜버렸다.

와이어드에 따르면 “인간과 대화 가능한 언어를 사용할 수 있도록 하기 위한 조치”라는 게 페이스북의 설명이다.

물론 의구심을 가질 수도 있다. SF 영화에서 흔하게 보던 오류가 실제로 발생했을 수도 있기 때문이다.

하지만 이런 ‘합리적 의심’을 갖기 위해선 최소한의 근거가 필요하다. 이를테면 문제의 AI가 고도로 발전된 지능을 갖고 있다는 등의 전제가 성립돼야 한다.

그런데 페이스북의 로봇은 한 가지 임무만 수행하도록 설계됐다. 간단하게 설계된 게임에서 가능한 많은 점수를 올리도록 하는 기능이다. 협상 능력 극대화란 단일 목적에 필요한 기능만 배양됐단 얘기다.

결국 이번 사례는 “AI가 인간을 왕따시키는 섬찟한 우려가 현실화”된 게 아니라 “현존 AI 기술의 한계를 보여준 것에 불과하다”는 게 와이어드의 분석이다.

■ AI가 '자신만의 언어' 만든 것도 이번이 처음 아냐

게다가 AI가 인간은 알아듣기 힘든 ‘자신만의 언어’를 만들어내도록 한 것도 이번이 처음은 아니라고 와이어드가 전했다. 가깝게는 지난 3월 일론 머스커가 후원하는 오픈AI도 로봇들이 가상세계에서 자신들만의 언어를 개발하는 실험을 한 적 있다.

결국 이번 해프닝은 영국 타블로이드 신문의 ‘과잉 보도’를 전 세계 수 많은 언론들이 무차별 인용 보도하면서 널리 확산됐다.

관련기사

- 'AI 왕따설'에 발끈한 페이스북…"낚시 기사다"2017.08.02

- 페이스북, 화상채팅 기기 출시 준비중2017.08.02

- 머스크 vs 저커버그…왜 AI 논쟁 벌였나2017.08.02

- 美 AI강자 비브는 왜 삼성을 택했을까2017.08.02

이런 호들갑에 깜짝 놀란 페이스북 연구팀의 한 관계자는 "우리 연구 논문을 직접 읽어보라"면서 관련 링크를 제시하기도 했다. (☞페이스북 논문 바로가기)

이번 해프닝을 보면서 이런 생각을 해봤다. “어쩌면 우리는 SF 영화를 너무 많이 본 것일 수도 있다”고.